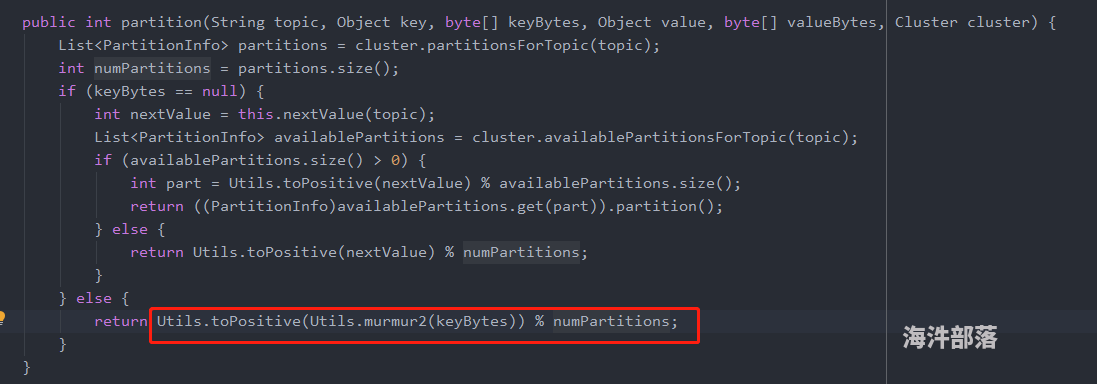

前提:producer 按照key 分区,如下图

按照以上代码,相同的key的数据应该进入同一分区。

出现问题:

flink 未按照正确的顺序,消费kafka的相同key数据。

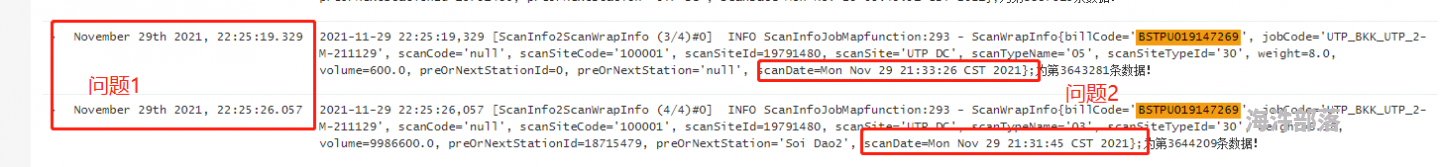

案例:

问题1 : 前提数据中间有写入oracle的情况

过了大概一个小时才处理之前发送的消息

问题2:

先消费了后发送的消息

老师,您说分区间保持one to one

是什么意思,该如何设置呢

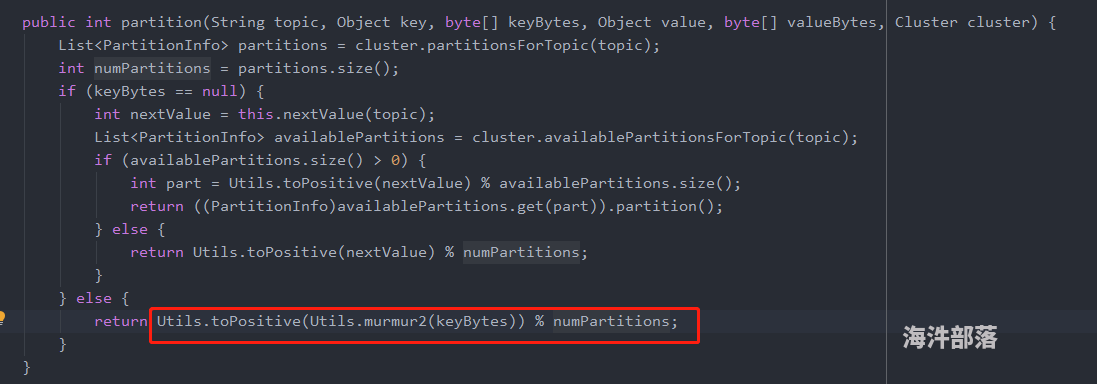

前提:producer 按照key 分区,如下图

按照以上代码,相同的key的数据应该进入同一分区。

出现问题:

flink 未按照正确的顺序,消费kafka的相同key数据。

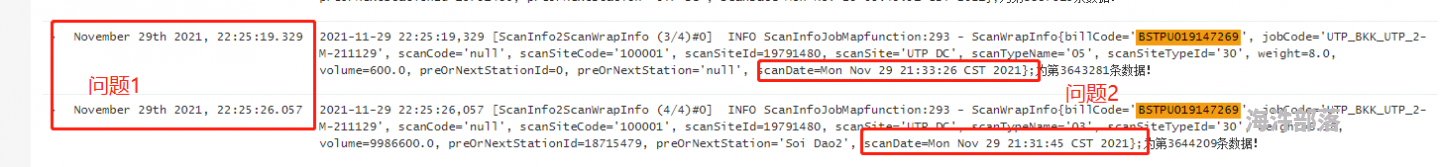

案例:

问题1 : 前提数据中间有写入oracle的情况

过了大概一个小时才处理之前发送的消息

问题2:

先消费了后发送的消息

老师,您说分区间保持one to one

是什么意思,该如何设置呢